当前车辆上摄像头的使用是很普遍的,例如普通的倒车影像、自动驾驶、DMS等,下面就来对其进行梳理一下。

01.

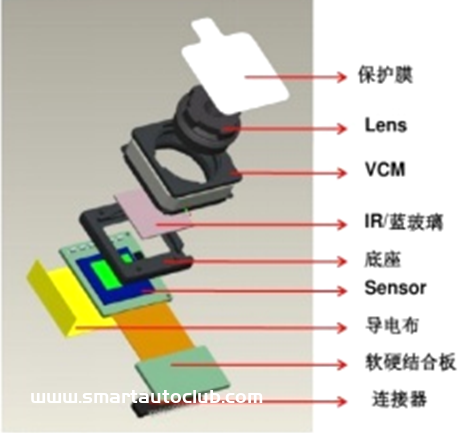

摄像头结构

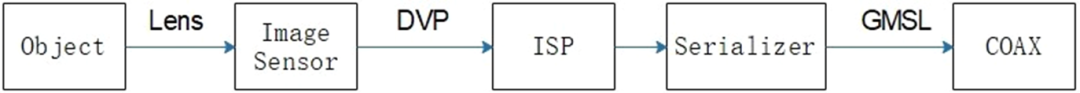

摄像头一般由镜头(Lens),图像传感器(Image Sensor),图像信号处理器(Image SignalProcessor, ISP),串行器发送(Serializer)组成 ,如下图所示

数据的传输步骤为镜头采集到物体的基本信息然后由Image Sensor进行一定处理后再交于ISP处理之后串行化传输。传输方式同样可分为在同轴电缆或双绞线上基于LVDS传输或者直接通过以太网传输。

02.

视角的影响

对车载摄像头而言,当前的技术发展对颜色,分辨率和帧率基本能满足自动驾驶软件的需求。例如AP2.5采用1080P(约2Mpixel),30fps,作为对比,小米10摄像头采用108M pixel,60fps的摄像头.

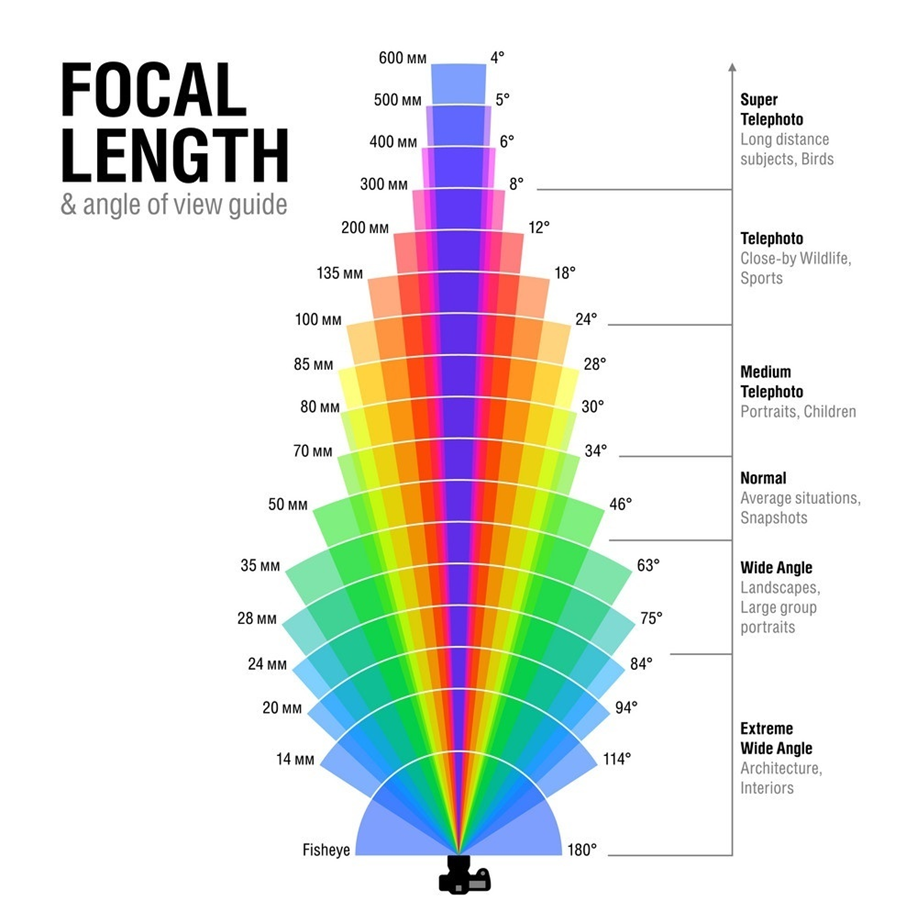

对于布置来说,主要是视角对感知范围的影响。在摄像头感光元件大小确定的情况下,焦距越长,对应的视角越窄。但对应的分辨率也能大大提高——即看的清,但看的东西少。

对于自动驾驶而言,不仅需要关注远方的路标,红绿灯,指示牌,车辆等信息做路线规划和预控判断,还需要观察距离比较近的是否有行人,岔道口是否有车辆驶入和收集车辆旁边的插队车辆,行人,自行车等信息进行风险预控等。当前单一摄像头是无法做到全视野的信息采集。因此L2级别以上基本会配置中程及长程摄像头。高档车辆会采用3前视摄像头的配置。

03.

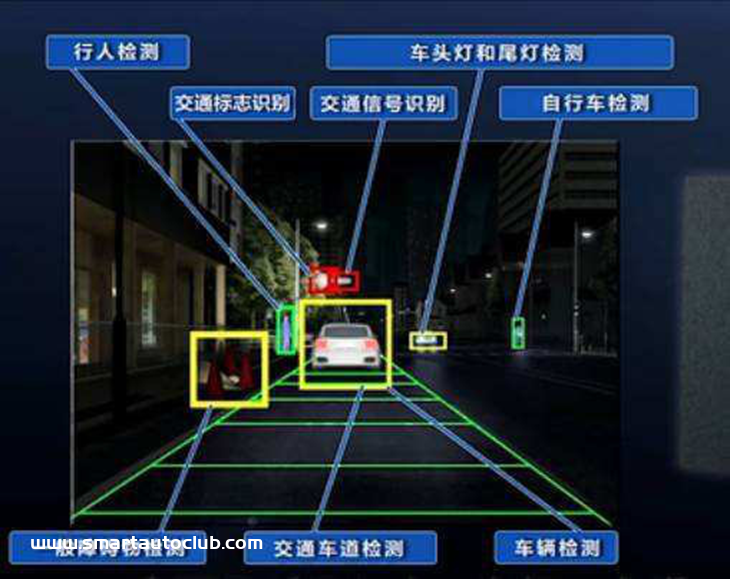

视觉传感器在自动驾驶系统中的主要作用

其他交通参与者探测与识别 - 车辆探测、行人探测、动物探测

04.

单目摄像头与双目摄像头测距原理对比

单目摄像头测距原理是先匹配识别后估算距离:通过图像匹配识别出目标类别,预估目标尺寸,随后根据图像大小估算距离。

单目系统的优势在于成本较低,对计算资源的要求不高,系统结构相对简单;

(1)需要不断更新和维护一个庞大的样本数据库,才能保证系统达到较高的识别率;

(3)距离并非真正意义上的测量,准确度较低。当前业内量产做到最好误差在10-15%左右。

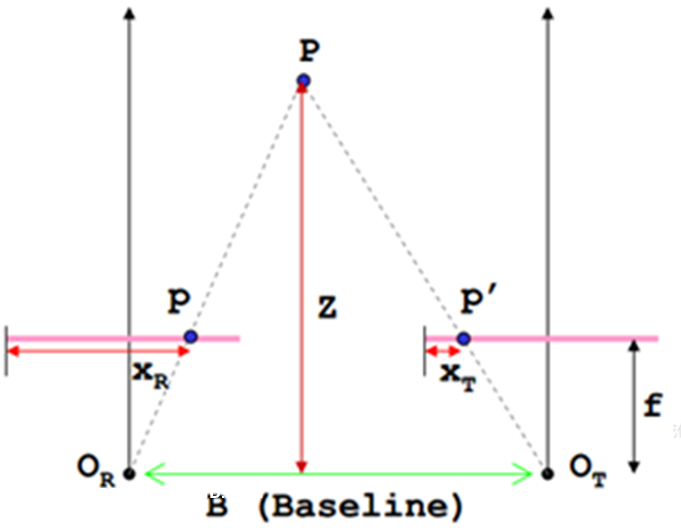

双目摄像头测距原理是双目三角测距的原理,对目标物体距离感知是一种绝对的测量,而非估算,原理如下图所示。

双目系统优势:

1)成本比单目系统要高,但比激光雷达等方案相比成本较低;

2)原理上无需先进行识别再进行测算,而是对所有障碍物直接进行测量;

3)无需维护样本数据库。

3)不适用于单调缺乏纹理的场景。对于与背景色接近的场景(天空、白墙、沙漠等)可能无法识别;

4)相机基线限制了测量范围,同时安装的精度和光心的尺寸偏差对测量结果影响很大,耐久一致性较难保证。

05.

摄像头数据传输

已量产的车型中摄像头数据处理分为两类,一种在摄像头处集成控制器进行特征提取和输出典型应用是Mobileye的EyeQ系列。如EyeQ4设计预留可同时处理8路摄像头数据,原始数据在EyeQ4中处理,可以提取车道线数据,10个行人和车辆目标信息,交通标识,自身车身姿态,测距信息(单目算法)。数据最后通过CAN-FD发送到中央处理器。另外一种是摄像头输出原始数据典型应用有TeslaHW2.5。HW2.5采用双NvidiaParker SoC加GP106显卡的计算单元,能处理12路摄像头数据。摄像头与视觉处理器之间的数据传输一般有两种选择:串行接口和以太网。当前普遍采用串行接口。

摄像头数据的串行传输物理层采用LVDS(Low Voltage Differential Signal)的接口。具有高速率(Gbps级)、低延迟、低功耗的特点。协议层主要解决方案为TI的FPD-Link、Maxim的GMSL等。目前市场上的传输协议具有专一性,不同供应商的产品无法通用。一般由控制器平台决定选择何种协议层。如HW2.5采用Nvidia方案所以选择的是GMSL协议,而在HW3.0上FSD则选择了TI的解决方案。

LVDS传输的原理:通过精准的线束阻抗匹配,以小电流的形式得到差分电压获得超高速的传输速率。(>1.8Gbps@15m,3G@10m)采用同轴电缆可有效地避免车规级EMC风险,同时降低成本。数据传输采用点对点双向通讯。每个摄像头需配置独立解码芯片,控制器端在每个摄像头通道的接收端也需配置独立的解码芯片。

原文始发于微信公众号(汽车ECU开发):一文了解车载摄像头