编辑:Mark

出品:红色星际(ID:redplanx)

头图:大疆车载智能驾驶图片

小林急匆匆地走进屋,“最近关于双目摄像头的讨论突然变得很热闹,特别是大疆车载的双目摄像头在五菱车上量产之后,大家对这块的关注明显增多”。

小周低头看了一下满头大汗的小林,笑着说,在我的记忆里,双目摄像头总是雷声大,雨点小。

小林疑问地问道,为啥啊?

小周问道,你知道为什么这些辅助驾驶车辆在高速上,看到奇形怪物,总是往上撞吗?

小林想了想,我好像之前听别人说过,单目摄像头主要是依靠庞大的样本库,如果样本库里没有这个样本,那么摄像头就识别不出来这个物体。

一般情况下,单目摄像头是先通过图像匹配进行目标识别,再通过目标在图像中的大小去估算目标距离,这就要求在估算距离之前首先对目标进行准确识别。

如果都不能识别出来,距离肯定也不能估算出来,所以一旦遇到奇形怪物,就下意识地忽略掉了,然后就撞上去了。

我这个理解对吗?

小周点点头,差不多是这个意思。对于单目摄像头而言,必须建立并不断维护一个庞大的样本特征数据库,保证数据库包含这个世界的所有奇形怪物。

所以,你听到的80%左右的自动驾驶车辆事故,大部分是撞上静止的车辆、非标的路障,以及非标的车辆如工程车等等。更有一些公司为了系统可以有效地检测到大型动物,特地跑到一个动物园,建一个大型动物数据库。

1. 双目摄像头的发展

小林笑着说道,原来如此啊。接着反问道,那你为什么说双目摄像头总是雷声大,雨点小?

小周转过身来看着小林,其实双目摄像头的发展已经有了二十多年了,最开始是在日本,后来扩展到欧美,最后传到了中国。但在中国,前几年双目摄像头更多是用在商用车的障碍物检测预警和AEB功能上,还没有用在真正的高级辅助驾驶上。

至于为什么双目摄像头发展比较慢,我觉得有几个原因吧。首先要知道双目摄像头到底有什么作用,它想补充什么功能或者是想取代什么传感器。

双目摄像头是按照仿生视觉的方法,由左右两个摄像机同步成像,并计算左右图像的视差,从而生成三维点云,通过视差的大小来测量物体与眼睛之间的距离。

小林突然蹦了一句话,这个是不是和3D电影的效果一样,通过偏光镜片,左眼看左相机的图像,右眼看右相机的图像,通过大脑理解视觉差异从而形成立体感觉。

小周笑着说,是的,就是这个原理。从双目摄像头的成像效果看,它主要想替换的是激光雷达,因为它的点云效果和测距与激光雷达的性能非常相似。

但10-20万的车型因为成本的原因,大家都用不起激光雷达,所以像大疆车载就使用双目摄像头和毫米波雷达的方案,应用在了五菱车上,弥补单目摄像头+毫米波雷达在奇形怪状障碍物的识别不足。

小林问道,就是说,前方只剩下双目摄像头和毫米波雷达?

小周点头,对,这个方案其实很激进,因为双目摄像头在测距和深度信息方面还不是很成熟和完美。

从测距方面看,大多数做双目的只能做到二三十米,因为两个相机之间的基线是确定的,安装在车上是不可能无限制放大的,所以在短基线情况下测远距离本身的技术难度会大很多。

当然也可以增加相机基线的距离,看得更远,但是视角会比较小。对于双目相机而言,尽量近处看到最近,远处尽量远,这是矛盾的。

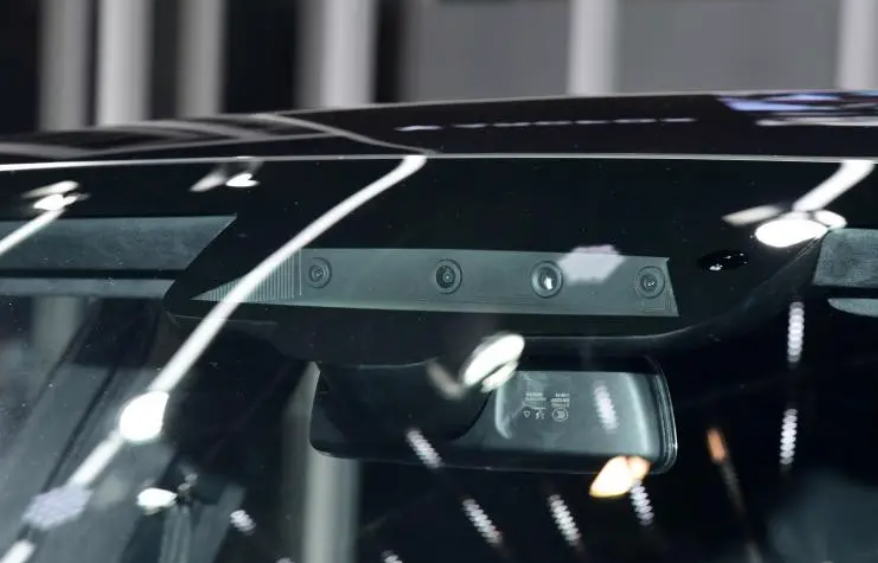

所以大疆车载在五菱的车上首先搭载的D80方案(时速80公里以内使用),而不是大家认为场景比较简单的高速方案;而华为的双目摄像头为了避免这个问题,在北汽极狐车型上,除了使用双目摄像头外,还使用了2个不同焦距摄像头来覆盖更远的距离和视角。

(华为双目摄像头图片)

小林笑着说,我明白了,现在大家用的双目摄像头都是被阉割过的,并没有达到双目摄像头理论上的效果。那如果加入4D毫米波雷达,双目摄像头+4D毫米波雷达是否可以在低成本方案上替换掉激光雷达呢?

小周想了想,你说得很对,双目摄像头虽然有理论支持,但是实现起来很难。理想状态下,双目摄像头和4D毫米波雷达的组合是有可能替换激光雷达的,但目前看,因为这2个传感器因为都是新产品,所以在产品一致性和性能稳定性方面都有不足。

特别是双目摄像头,随着测距距离达到50米以上、100米以上,水平视觉只有30度,视差会变得越来越小,测距精度和稳定程度的挑战也会越来越大,这就对于双目摄像头高精度的生产和一致性提出了严苛的要求。

包括标定方法,但这些我觉得随着工艺和算法的提升可以逐渐提高。但现在双目摄像头最大的一个问题是生态没有建立起来。

双目摄像头更多还是一个补充传感器,没有像单目摄像头,或者激光雷达一样,已经变成了方案融合的中心。反而更像是一个替代的效果,一方面想替代激光雷达的三维建图,一方面又想替代毫米波的测距功能。

但是相对这2个传感器的高性能,双目摄像头又达不到,所以更多是在低成本方案中部分替代激光雷达的效果,高成本方案中,作为一个补充。

我们来看一段历史,就知道了。中国的单目和双目的创业公司,最初都是用在商用车上,主要是因为当时中国政府出了一个政策,就是所有的商用车都得配有双预警系统。

像Maxieye,Minieye等都是单目摄像头的创业者,像中科慧眼等都是双目摄像头的创业者。但是发生了一件很奇怪的现象,等到大家想从商用车这个几百万规模的市场,转到乘用车这个几千万规模的市场时,只有单目摄像头的公司转了过来,而双目的基本都还停留在商用车市场。

现在市场上做双目摄像头,像华为和大疆,包括创业公司鉴智机器人,他们都是一开始就是从乘用车开始做的。

小林想了想,确实,鉴智机器人应该说是过去一年辅助驾驶领域的香饽饽,1年时间就融了5亿元左右,用1年的时间走了别人5年走的路。可为什么商用车的公司都没有转过来呢?

小周站了起来,我觉得主要原因是以双目摄像头为融合中心的生态没有建立起来,也和行业的发展节奏有关。

过去几年,双目摄像头更多的是用在服务机器人上,用在车上的很少,主要原因是车规级的产品一般要求都比较高,特别是对于双目摄像头这样涉及到精密制造的产品,如果标定都有问题,谈精准测量都是空谈。

像华为的高层讲的,双目一大堆问题,简单点说从机械上有标定的问题,从算法上其实想把双目用好并不容易,因为双目要解决的本质问题是深度测量,但深度测量本身想测量比较稳定、可泛化其实是很难的问题。

传统的双目立体视觉方案对结构、稳定性和可靠性要求较高,国外相关厂商已具备多年经验,而国内解决方案厂商目前处于起步阶段,所以需要像大疆,华为这样的大厂来带动整个板块的制造水平。

第二个因素,也是最主要的因素,就是双目摄像头更多的还是作为一个辅助工具,并没有真正地融入辅助驾驶系统,加上乘用车上基本都是清一色的单目为主,所以很难从商用车跨界过来。

在乘用车市场,单目摄像头融合的生态已经很成熟了,但是双目摄像头才刚刚开始,所以对于商用车辅助驾驶初创公司而言,重新建立一套双目摄像头的生态太难了,所以他们都被迫留在了商用车市场,有的也向服务机器人方向拓展,就是进不来乘用车。

小林疑惑道,为什么单目摄像头的生态很完善,而双目摄像头的生态却迟迟没建立起来?

小周思考了一下,这与历史和产品的发展有关。

单目摄像头融合领域,有老大哥Mobileye,特斯拉等,通过大量的数据积累,建立了自己的数据库,而且加上一堆的跟随者,以前视单目为融合中心的生态形成了。

而且,单目摄像头因于成本较低,对计算资源的要求不高,系统结构相对简单,所以在行业最先发展,视觉融合技术方案也最成熟。一个单PFGA芯片就够了,而且产品稳定性和一致性很好。

双目系统的一个难点在于计算量非常大,对计算单元的性能要求非常高,这使得双目系统的产品化、小型化的难度较大。之前国际上使用双目的研究机构或厂商,绝大多数是使用服务器来进行图像处理与计算的;也有部分将算法进行简化后,使用FPGA进行处理。

但一些FPGA方案中有很多噪点与空洞,对后续计算不利,所以有些公司专门开发了专用芯片来适配双目摄像头。

小林想了想,那现在为什么又受到关注了?

小周笑着说,因为大厂进来了。现在大家不再是单独做一个传感器,而是直接提供让双目成为融合中心的视觉方案。

2. 双目摄像头生态

之前的双目更多的还是识别,没有到为主的地步。所以大家的关注没那么多,但现在这批做双目摄像头的公司,是以双目摄像头为主的融合,直接去掉了前视单目摄像头。

单目摄像头的成功不仅仅是因为传感器的成熟,还有与之匹配的数据库,算法和融合方式。双目摄像头如果仅仅作为一个补充传感器,没有与之匹配的生态,是很难快速发展起来的。

所以我们看到像大疆车载,通过大疆车载自研双目BEV车道线检测及融合和双目3D物体检测及融合等技术,让双目摄像头成为了融合的中心。

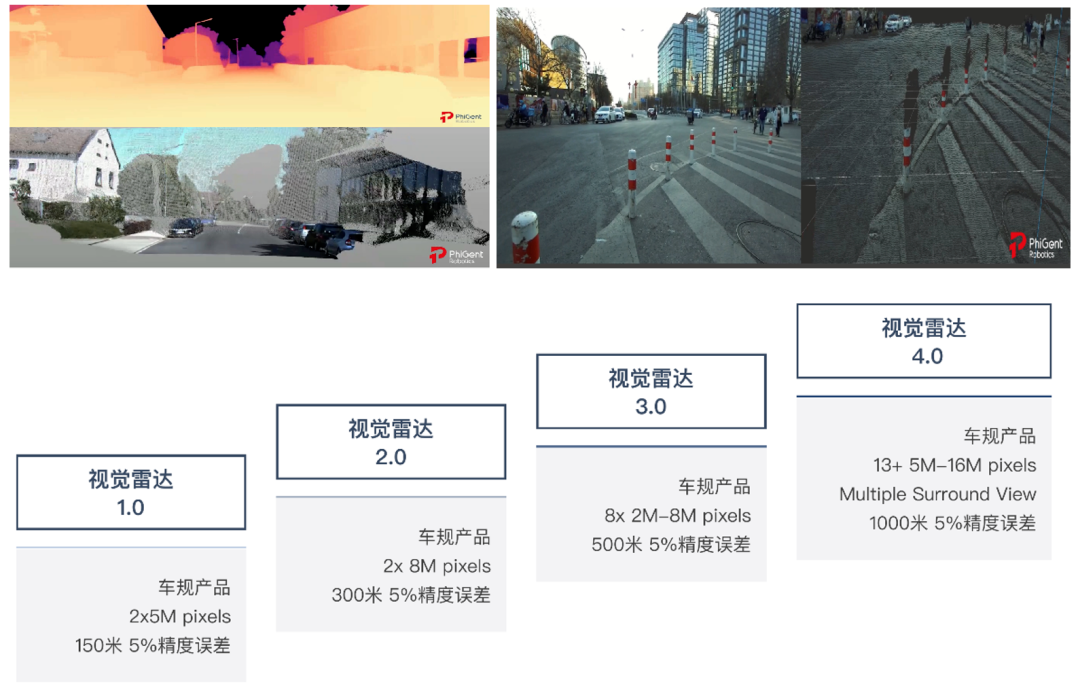

(鉴智机器人视觉雷达图片)

像鉴智机器人,采用双核心驱动的技术路线,通过高阶自动驾驶解决方案和双目视觉雷达的完整产品布局,试图建立双目摄像头生态。

这批公司进来不是从单独的双目摄像头切入,而是从整体方案入手。他们是带着融合生态来的,而且都已经拿到定点。

因为无论是对于单目摄像头,还是双目摄像头,最终仍然需要一套决策机制进行最终的决策,而整套决策的优劣直接决定了是以谁为融合的中心,而不是单纯的提高某个传感器或者作为一个补充传感器。

特别是鉴智机器人,整体方案使用的是老东家的地平线征程5芯片,本身就对这款芯片的性能了如指掌,所以才能在过去的1年在双目摄像头融合生态中崭露头角。

小林突然感悟了,看来,跟对大哥很重要,选对生态合作伙伴会让自己的产品突飞猛进。

小周笑着说,是的,跟对大哥很重要。立体视觉的关键在于算法的先进性,算法越高级,边缘会与原始的图像越接近、准确度越高。

所以说,只有建立完整的生态,整个行业才能快速地发展,而不是仅仅作为一个补充传感器。

当然还有一个因素,是整个行业到了以3D视觉为主导的技术发展期。

随着自动驾驶的发展和应用场景的广泛,以图像2D感知和规则后融合为主的视觉感知系统遇到了明显的局限和瓶颈,包括测距测速准确性和稳定性、多摄像头结果拼接一致性、规则系统迭代效率等一系列问题。

而高质量、大规模的4D场景数据,端到端的4D感知正在成为技术趋势。一方面可对于交通参与者进行更优的运动轨迹预测,从而实现性能更加优异地规划控制;另一方面可对于道路行驶区域预测更加精细的3D结构化信息,在线生成局部实时3D地图,降低对高精地图等基础设施的依赖。

小林问道,那你认为双目摄像头什么时候可以落地呢?

小周思考片刻,单目和双目因为检测原理上的差异,双目摄像头硬件成本和计算量级的加倍,是难关也是突破口。

摄像头的成本是最低的,单目相机的价格一般低于100美元,双目摄像头大概在200美元左右。用在扫地或者酒店服务机器人的双目3D感知的相机,因为不是车规级的,成本更便宜,大概在100-200元左右。

之前可能双目摄像头价格比较高,主要用在高端车上。

但随着相关产品产量的进一步提升,相关技术的不断成熟,供应链的进一步完善,双目视觉产品的价格有望与单目视觉产品的价格越来越接近。

特别是大厂的进入,让整个行业的生产工艺都提高很多。

但是有一个问题,就是现在市面上已经量产的方案大多是后融合方案,大家会慢慢地转向基于特征层面的前融合路线,是否由比较平滑过渡的算法框架能帮助车厂去做融合的迁移,这个大概需要1-2年的转换过程。

小林看了一下马上到吃中午饭的时间,我再问一个终极问题,就是双目摄像头融合未来会全面取代单目摄像头吗?

小周沉思片刻,目前阶段,应该没有那么快,其实单目摄像头和双目摄像头并不是竞争的关系,而是互补的关系,像华为的前视四目摄像头,既有双目摄像头,又有单目摄像头,有些公司甚至使用三目摄像头。

系统既可以通过单个摄像头实现车道线、路标和车辆类型识别,同时还可以利用两个摄像头做物体的立体匹配,它们之间可以通过融合构成多维视觉。

像你刚才问的4D雷达问题,做双目的更希望看到4D雷达的出现,如果双目能够很好的和4D雷达融合,从数据源的质量和一致性融合的难度也会小很多。

未来单双目方法的融合,视觉与雷达等其他类型传感器的融合,不同视角,焦段的相机融合,是双目相机的发展趋势。

但像大疆和鉴智机器人直接用双目摄像头取代前视单目摄像头,是有点激进,但市场需要这样的先锋。

小林点点头,确实。

通过一上午的交谈,小林心里很满足,但肚子却在咕噜咕噜的叫着,小林站了起来,你中午想吃啥,我请你。

小周想了想,走,天上人间。两人有说有笑的打了个车,踏上了去天上人间的路上。

-END-

关注我们,获取更多深度解读

原文始发于微信公众号(红色星际):热议双目摄像头

Download: