点击图片加入汽车HMI通讯录

但在语音交互技术还不够完善而不足以支撑起语音助手的智能化时,本身不具有实际功能的IP形象似乎缺乏一些存在的意义。毕竟在更广范围的应用场景下“能听懂”更多的语音指令这一技术性指标才是人们对语音助手最核心的期待,而不只是满足于那个能对你眨眨眼、扭一扭却不干实事的所谓的助手。

那么车载语音助手的视觉IP形象到底能否为驾驶带来实际的作用呢?还是有一定的可用性的。最近恰好读到一篇文章,研究结果证明Eco-safe driving HMI界面能够改善驾驶员在交叉路口时的驾驶行为。实验所用的HMI界面由不同条件的虚拟表情组成,为车载形象存在的实际意义提供了支撑。

那么车载语音助手的视觉IP形象到底能否为驾驶带来实际的作用呢?还是有一定的可用性的。最近恰好读到一篇文章,研究结果证明Eco-safe driving HMI界面能够改善驾驶员在交叉路口时的驾驶行为。实验所用的HMI界面由不同条件的虚拟表情组成,为车载形象存在的实际意义提供了支撑。

文献:《Exploring drivers’mental workload and visual demand while using an in-vehicle HMI for eco-safe driving》

01

背景

02

实验设置

实验设备:模拟器包含一个真实的乘用车客舱(Holden Commodore)和一个用于模拟发动机与环境噪声的环绕音响系统,车辆安装在一个六自由度的运动平台上,可以进行三维运动和扭转。

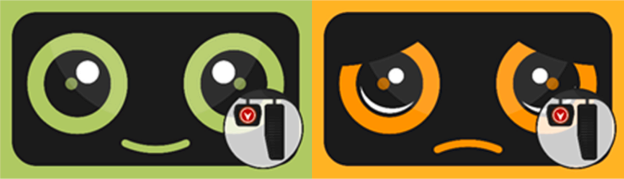

Eco-safe driving人机界面设计:对应各种不同的Eco-safe driving安全驾驶信息来变换给出不同的表情进行反馈,安置于挡风玻璃中心偏下位置。

界面中的信息包括:

缓慢刹车与缓慢加速的意见提示

反馈信息

当司机减速或加速行动完成后,系统会根据驾驶员的行为表现来反馈他们是否进行了正确操作。比如正确操作后的绿色与笑脸的正反馈,不当操作后的橙色与哭脸的负反馈。

03

实验过程

-

对照组(BL):不提供环保安全信息

-

仅提供意见(AO): HMI界面上只显示相关意见

-

仅提供反馈(FO): HMI界面上只显示反馈信息

-

意见与反馈(AF): HMI界面同时显示意见和反馈信息

在实验路线设定的两个测试路口的场景为:有停车标志以及往来车辆行驶的十字路口和有停车标志而没有往来车辆行驶的三叉路口。在每次驾驶过程中,参与者都会经历一次这两种场景。对于每个参与者,每种条件的驾驶大约需要10分钟完成,整个实验持续约1小时。每种条件中间参与者将有5分钟的休息时间。

每种条件的驾驶完成后,参与者会完成美国宇航局任务负荷指数(NASA-TLX)量表来衡量他们的主观的工作负载。

04

数据处理

数据分析的场景分别为有交通(场景1)和无交通(场景2)的停车标志交叉口,每个场景的可视化数据提取范围为交叉口停车线前30米到停车线后80米。

通过faceLAB眼球跟踪系统来收集驾驶员的眼球运动包括眼睛的眨眼和瞳孔大小变化,并通过模拟器收集车辆控制数据。最终处理实验变量包括包括最大制动力(N)、制动力标准差(SD, N)、平均加速度(m/s2)、总眨眼时间(s)、平均眨眼持续时间(s)、眨眼频率(数/s)、瞳孔大小(平均瞳孔直径,mm)和NASA-TLX评分。

以最大制动力、制动力SD和平均加速度这三个行为变量来检验环保安全人机界面在改善驾驶员接近和离开交叉路口时的减速和加速性能方面的有效性。

05

实验结论

当Eco-safe drivingHMI界面同时提供建议和反馈信息(AF)时,驾驶员在接近十字路口时倾向于采用更平稳的刹车控制。然而,HMI对这种减速行为的影响仅在交叉口有往来车辆的交叉路口显著,而对加速行为而言在在两个交叉口均有显著效果。结果表明,所提出的环保安全驾驶人机界面在改善驾驶员在十字路口的行为表现方面是有效的。

总结:

识别二维码加入群聊

推荐阅读:

阅读原文,即可加入群友通讯录!

原文始发于微信公众号(智能汽车俱乐部):车载语音交互HMI设计与驾驶安全